VESSL AI 뉴스

25 January 2026

GPU 1만장 확보 나선 정부…“이제 관건은 운영 솔루션”

GPU ‘확보 이후 단계’는 과제로 지적…운영 솔루션 없인 정책 효과 제한 우려

정부가 인공지능(AI) 경쟁력 강화를 위해 대규모 그래픽처리장치(GPU) 확보에 나섰다. 다만 GPU 물량을 늘리는 것만으로는 정책 효과가 제한될 수 있다는 지적이 나온다. GPU를 실제 연구·산업 현장에서 효율적으로 운영할 솔루션이 뒷받침되지 않으면, 확보한 자원이 기대만큼 활용되지 못할 수 있다는 의견이다.

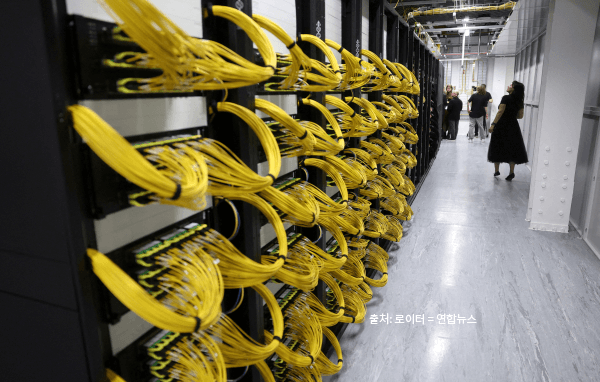

GPU는 AI 학습과 추론 과정에서 대규모 계산을 동시에 처리하는 핵심 연산 장치다. 최근에는 개별 컴퓨터가 아닌 AI 데이터센터에 집적돼 여러 연구기관과 기업이 공동으로 사용하는 인프라 자원으로 활용된다.

25일 과학기술정보통신부에 따르면, 지난해 추가경정예산으로 확보한 GPU 약 1만장을 이르면 오는 3월부터 공급할 계획이다. 정부는 내달까지 수요 평가를 거쳐 국가 프로젝트에 50%, 산업계에 30%, 학계·연구계에 20%를 배분한다는 방침이다. 7월 한국과학기술정보연구원(KISTI)의 슈퍼컴퓨터 6호기 가동 이전까지 GPU를 집중적으로 제공해 연구와 산업 현장의 활용도를 높이겠다는 구상이다.

정부가 발표한 대·중소기업 상생 성장전략에는 GPU 활용 방안이 구체화됐다. 정부는 목표한 전체 확보 물량 5만2000장 가운데, 지난해 추경으로 마련한 약 1만장의 GPU 중 약 30%를 중소기업과 스타트업에 배분할 계획이다. 정부는 GPU 확보 사업과 국가 AI 컴퓨팅센터 사업을 연계해, 유망 AI 스타트업과 중소기업의 활용을 촉진한다는 방침도 함께 제시했다.

정책 방향은 분명하지만, 현장에서는 GPU ‘확보 이후 단계’에 대한 우려가 제기된다. GPU는 단순히 장비를 배치하는 것만으로 성과가 나오지 않는다. 여러 과제와 조직이 동시에 GPU를 사용하는 환경에서는 어떤 작업에 얼마만큼의 자원을 배정할지, 사용 중인 GPU를 어떻게 회수·재배치할지 운영 관리가 필수적이다. 이 과정이 체계화되지 않으면 일부 GPU는 사용되지 않고, 일부는 과부하에 걸리는 비효율이 발생할 수 있다는 설명이다.

특히 AI 기술이 연구 단계를 넘어 실제 서비스와 국가 프로젝트로 확산되면서 운영 문제는 더욱 두드러지고 있다. 소규모 실험이나 단기 과제에서는 큰 문제가 드러나지 않지만, 장기간 연속 운영이 필요한 단계에 접어들면 관리 복잡성과 비용 부담이 빠르게 커진다. GPU 사용량을 실시간으로 조절하고 장애를 관리하는 운영 솔루션이 없을 경우, 서비스 중단이나 재설계로 이어지는 사례도 반복되고 있다는 지적이다.

비용 문제도 핵심 변수다. GPU는 사용 시간에 따라 비용이 발생하는 구조인 만큼, 운영 관리가 제대로 이뤄지지 않으면 예산 대비 활용률이 급격히 떨어질 수 있다. 확보한 물량이 많아질수록 오히려 관리 부담이 커질 수 있다는 의미다. 현장에서는 “GPU를 더 들여오기보다, 이미 확보한 자원을 어떻게 굴릴지에 대한 기준과 솔루션이 더 시급하다”는 목소리가 나온다.

이 때문에 GPU 정책의 초점도 단순한 물량 경쟁에서 운영 역량으로 이동해야 한다는 분석이 제기된다. GPU를 어떤 과제에, 어떤 방식으로 배분하고 관리할지에 대한 체계가 갖춰져야 정부 투자가 실제 연구 성과와 산업 경쟁력으로 이어질 수 있다는 것이다. 확보 이후 단계에 대한 설계 없이 GPU 공급만 확대될 경우, 정책 효과가 제한될 수 있다는 지적이다.

AI 인프라 기업 베슬AI 관계자는 “GPU를 대규모로 도입했지만 운영 체계가 미흡해 실제 활용률이 30~40% 수준에 머무는 사례도 적지 않다”면서 “공공 GPU 인프라는 연구, 스타트업 지원, 국가 전략 AI 개발 등 서로 다른 목적의 수요가 동시에 몰리는 구조다. 단순한 클라우드 방식이나 수동 운영만으로는 자원 충돌과 비효율을 피하기 어렵다”고 설명했다.

이어 “GPU 사용 우선순위 설정, 프로젝트별 자원 격리, 성능과 비용에 대한 가시성 확보, 장애 발생 시 자동 복구까지 포함하는 전문적인 GPU 운영·오케스트레이션 솔루션이 병행돼야 정책 효과를 극대화할 수 있다”며 “결국 AI 경쟁력은 장비 보유량이 아니라, GPU를 얼마나 지능적으로 배분·제어·자동화하느냐에 달려 있다”고 덧붙였다.

출처 : 매일일보 = 오시내 기자

VESSL AI Team

Try VESSL today

Build, train, and deploy models faster at scale with fully managed infrastructure, tools, and workflows.